En Combinación con el Nuevo Sistema de Switches NVlink, cada DGX SuperPOD Ofrece 1 Exaflop de Rendimiento de IA; se Espera que la Nueva Supercomputadora NVIDIA Eos Sea el Sistema de IA Más Rápido del Mundo; El Acceso Está Disponible de Inmediato Para los Clientes a través del Servicio DGX Foundry Expandido

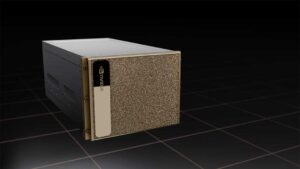

El día de hoy, NVIDIA anunció el sistema NVIDIA DGX de cuarta generación, la primera plataforma de IA del mundo que se fabrica con las nuevas GPU NVIDIA H100 Tensor Core.

Los sistemas DGX H100 ofrecen la escala que se exige para cumplir con los enormes requisitos de computación de los grandes modelos de idiomas, los sistemas de recomendación, la investigación de la salud y los avances en la ciencia del clima. Con ocho GPU NVIDIA H100 por sistema, conectadas por NVIDIA NVLink®, cada DGX H100 proporciona 32 petaflops de rendimiento de IA con la nueva precisión FP8, 6 veces más que la generación anterior.

Los sistemas DGX H100 son los componentes fundamentales de las plataformas de infraestructura de IA NVIDIA DGX POD™ y NVIDIA DGX SuperPOD™ de próxima generación. La arquitectura DGX SuperPOD más reciente cuenta con un nuevo Sistemas de Switches NVIDIA NVLink que puede conectar hasta 32 nodos con un total de 256 GPU H100.

Al proporcionar 1 exaflops de rendimiento de IA FP8, 6 veces más que su predecesora, la DGX SuperPOD de próxima generación expande las fronteras de la IA con la capacidad de ejecutar enormes cargas de trabajo de LLM con billones de parámetros.

«La IA ha cambiado fundamentalmente lo que el software pu ede hacer y cómo se produce, y las empresas que revolucionan sus industrias con la IA se dan cuenta de la importancia de su infraestructura de IA», dijo Jensen Huang, fundador y CEO de NVIDIA. «Nuestros nuevos sistemas DGX H100 potenciarán las fábricas de IA empresarial para refinar datos en nuestro recurso más valioso, la inteligencia».

ede hacer y cómo se produce, y las empresas que revolucionan sus industrias con la IA se dan cuenta de la importancia de su infraestructura de IA», dijo Jensen Huang, fundador y CEO de NVIDIA. «Nuestros nuevos sistemas DGX H100 potenciarán las fábricas de IA empresarial para refinar datos en nuestro recurso más valioso, la inteligencia».

Presentamos NVIDIA Eos, la Supercomputadora de IA Más Rápida del Mundo

NVIDIA será la primera empresa en construir una DGX SuperPOD con la revolucionaria arquitectura de IA para impulsar el trabajo de los investigadores de NVIDIA que avanzan en la ciencia del clima, la biología digital y el futuro de la IA.

Se espera que su supercomputadora «Eos» sea el sistema de IA más rápido del mundo después de que comience a operar a finales de este año, con un total de 576 sistemas DGX H100 con 4608 GPU DGX H100.

Se espera que NVIDIA Eos proporcione 18.4 exaflops de rendimiento de computación de IA, 4 veces más rápido de procesamiento de IA que la supercomputadora Fugaku en Japón, que actualmente es el sistema más rápido del mundo. Para la computación científica tradicional, se espera que Eos proporcione 275 petaflops de rendimiento.

Eos servirá como base para la infraestructura de IA avanzada de NVIDIA, así como sus socios OEM y de cloud.

La IA Empresarial Se Escala Fácilmente con los Sistemas DGX H100, DGX POD y DGX SuperPOD

Los sistemas DGX H100 se escalan fácilmente para cumplir con las demandas de la IA a medida que las empresas crecen desde los proyectos iniciales hasta las implementaciones amplias.

Además de las ocho GPU H100, con un total de 640,000 millones de transistores, cada sistema DGX H100 incluye dos DPU NVIDIA BlueField®-3 para descargar, acelerar y aislar servicios de seguridad, almacenamiento y redes avanzadas.

Ocho adaptadores de red NVIDIA ConnectX®-7 Quantum-2 InfiniBand proporcionan una tasa de transferencia de 400 gigabits por segundo para conectarse con la computación y el almacenamiento. Esto es el doble de velocidad que el sistema de la generación anterior. Además, un NVLink de cuarta generación, combinado con NVSwitch™, proporciona una conectividad de 900 gigabytes por segundo entre cada GPU en cada sistema DGX H100. Es decir, 1.5 veces más que la generación anterior.

Los sistemas DGX H100 aprovechan las CPU x86 dobles y se pueden combinar con las redes y el almacenamiento de NVIDIA, disponibles mediante los socios de NVIDIA, para crear instancias de DGX POD flexibles para la computación de IA en cualquier tamaño.

DGX SuperPOD proporciona un centro de excelencia de IA empresarial escalable con sistemas DGX H100. Los nodos DGX H100 y las GPU H100 en un DGX SuperPOD se conectan mediante un Sistema de Switch NVLink y NVIDIA Quantum-2 InfiniBand, lo que proporciona un total de 70 terabytes/s de ancho de banda, 11 veces más que la generación anterior. El almacenamiento de los socios de NVIDIA se probará y certificará para satisfacer las demandas de la computación de IA DGX SuperPOD.

Se pueden combinar varias unidades DGX SuperPOD para proporcionar el rendimiento de IA necesario para desarrollar enormes modelos en industrias como la automotriz, la salud, la manufactura, las comunicaciones, la venta minorista y más.

NVIDIA DGX Foundry Acelera el Éxito del Cliente con DGX SuperPOD

La solución de desarrollo alojada NVIDIA DGX Foundry se expande en todo el mundo para darles a los clientes de DGX SuperPOD acceso inmediato a la infraestructura de computación avanzada mientras sus sistemas están siendo instalados. Las nuevas ubicaciones agregadas en América del Norte, Europa y Asia ofrecen acceso remoto a diferentes DGX SuperPOD, o una porción de una instancia.

DGX Foundry incluye el software NVIDIA Base Command™, que les permite a los clientes administrar fácilmente el ciclo de vida de desarrollo de IA integral en la infraestructura DGX SuperPOD.

Las empresas calificadas pueden experimentar los sistemas NVIDIA Base Command y DGX de forma gratuita mediante los laboratorios seleccionados disponibles a través de NVIDIA LaunchPad, que se encuentran en ubicaciones de Equinix Metal de todo el mundo.

MLOps, el Software de IA Empresarial Apoya la Adopción Creciente de la IA por parte de los Clientes

Para apoyar a los clientes de DGX que están operando el desarrollo de IA, las soluciones de MLOps de los socios de Software NVIDIA DGX-Ready incluidos Domino Data Lab, Run:ai y Weights & Biases se unen al programa «Aceleración de IA con NVIDIA».

Las aplicaciones de MLOps de los socios participantes se validarán para proporcionar a los clientes de DGX soluciones de organización, programación y administración de clústeres y de workflows de grado empresarial.

Además, los sistemas NVIDIA DGX ahora incluyen el conjunto de software NVIDIA AI Enterprise, que es compatible con la infraestructura bare-metal. Los clientes de DGX pueden acelerar su trabajo con los modelos previamente entrenados de plataforma de IA de NVIDIA, los kits de herramientas y los frameworks que se incluyen en el conjunto de software, como NVIDIA RAPIDS™, el Kit de Herramientas NVIDIA TAO, el Servidor de Inferencia NVIDIA Triton™ y mucho más.